El tecnototalitarismo que viene / Censura algorítmica e Inteligencia Artificial en la moderación de contenidos (IV)

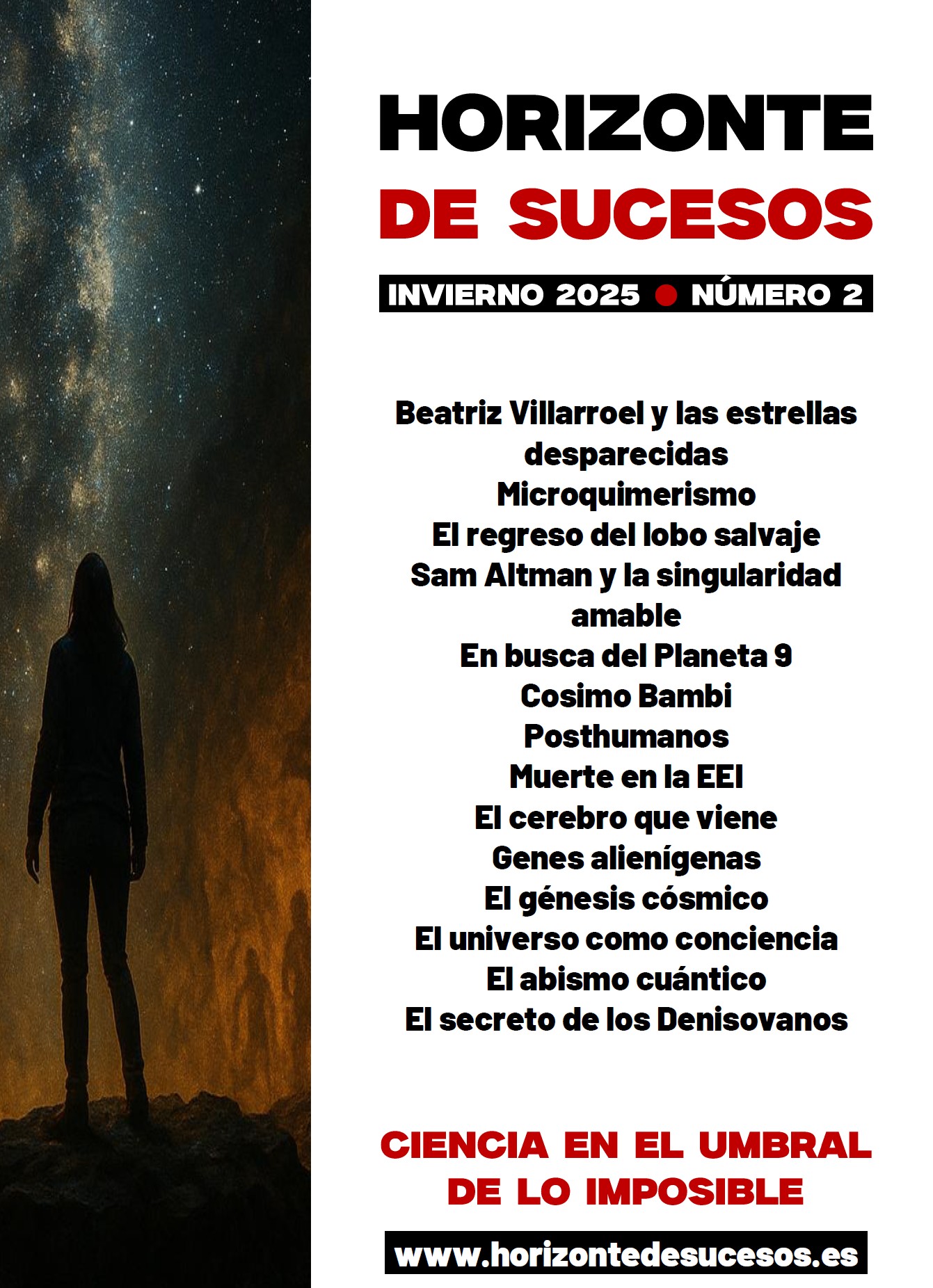

![[Img #27488]](https://latribunadelpaisvasco.com/upload/images/02_2025/2114_dalle-2025-02-27-152610-a-watercolor-style-digital-painting-depicting-the-concept-of-algorithmic-censorship-and-ai-content-moderation-the-image-features-a-futuristic-digital.webp) En la era digital, la moderación de contenido se ha convertido en una herramienta clave para mantener el orden en las plataformas en línea. Sin embargo, el uso de inteligencia artificial (IA) para filtrar, censurar y priorizar información ha generado preocupaciones sobre la transparencia, la libertad de expresión y el sesgo ideológico en los algoritmos.

En la era digital, la moderación de contenido se ha convertido en una herramienta clave para mantener el orden en las plataformas en línea. Sin embargo, el uso de inteligencia artificial (IA) para filtrar, censurar y priorizar información ha generado preocupaciones sobre la transparencia, la libertad de expresión y el sesgo ideológico en los algoritmos.

El papel de la IA en la moderación de contenidos

Las grandes plataformas tecnológicas como Facebook, Twitter y YouTube utilizan algoritmos de IA para:

- Detectar y eliminar "discursos de odio" y "desinformación".

- Priorizar contenido basado en interacciones y engagement.

- Bloquear cuentas que infringen sus políticas de uso.

Aunque estas medidas se justifican con la intención de combatir el contenido dañino, la falta de supervisión humana y la opacidad en los criterios de moderación han llevado a errores y sesgos preocupantes.

Problemas y controversias

Sesgo ideológico y discriminación

Se han reportado casos donde ciertos discursos políticos o ideologías son más propensos a ser censurados.

La IA puede reflejar los prejuicios de sus programadores o de los datos con los que fue entrenada.

Errores en la moderación

Contenido legítimo eliminado por error debido a interpretaciones incorrectas de la IA.

Falsos positivos que afectan la visibilidad de información verídica.

Consecuencias de la censura algorítmica

El control automatizado de la información tiene serias implicaciones:

- Reducción del debate público: Al limitar ciertos temas, se restringe la diversidad de opiniones.

- Poder centralizado en pocas empresas: Grandes corporaciones tecnológicas tienen la capacidad de influir en la opinión pública.

- Dependencia de la automatización: Las decisiones algorítmicas pueden reemplazar el criterio humano en la moderación.

Posibles soluciones

Para abordar estos desafíos, se sugieren varias medidas:

- Mayor transparencia en los algoritmos de moderación.

- Supervisión humana combinada con IA para evitar errores injustos.

- Derecho a apelar las decisiones de censura mediante procesos claros y accesibles.

El uso de inteligencia artificial en la moderación de contenido plantea un dilema entre seguridad y libertad de expresión. La clave está en desarrollar sistemas más justos y transparentes que equilibren la eliminación del contenido nocivo sin comprometer el derecho a la información y el debate abierto en la sociedad digital.

![[Img #27488]](https://latribunadelpaisvasco.com/upload/images/02_2025/2114_dalle-2025-02-27-152610-a-watercolor-style-digital-painting-depicting-the-concept-of-algorithmic-censorship-and-ai-content-moderation-the-image-features-a-futuristic-digital.webp) En la era digital, la moderación de contenido se ha convertido en una herramienta clave para mantener el orden en las plataformas en línea. Sin embargo, el uso de inteligencia artificial (IA) para filtrar, censurar y priorizar información ha generado preocupaciones sobre la transparencia, la libertad de expresión y el sesgo ideológico en los algoritmos.

En la era digital, la moderación de contenido se ha convertido en una herramienta clave para mantener el orden en las plataformas en línea. Sin embargo, el uso de inteligencia artificial (IA) para filtrar, censurar y priorizar información ha generado preocupaciones sobre la transparencia, la libertad de expresión y el sesgo ideológico en los algoritmos.

El papel de la IA en la moderación de contenidos

Las grandes plataformas tecnológicas como Facebook, Twitter y YouTube utilizan algoritmos de IA para:

- Detectar y eliminar "discursos de odio" y "desinformación".

- Priorizar contenido basado en interacciones y engagement.

- Bloquear cuentas que infringen sus políticas de uso.

Aunque estas medidas se justifican con la intención de combatir el contenido dañino, la falta de supervisión humana y la opacidad en los criterios de moderación han llevado a errores y sesgos preocupantes.

Problemas y controversias

Sesgo ideológico y discriminación

Se han reportado casos donde ciertos discursos políticos o ideologías son más propensos a ser censurados.

La IA puede reflejar los prejuicios de sus programadores o de los datos con los que fue entrenada.

Errores en la moderación

Contenido legítimo eliminado por error debido a interpretaciones incorrectas de la IA.

Falsos positivos que afectan la visibilidad de información verídica.

Consecuencias de la censura algorítmica

El control automatizado de la información tiene serias implicaciones:

- Reducción del debate público: Al limitar ciertos temas, se restringe la diversidad de opiniones.

- Poder centralizado en pocas empresas: Grandes corporaciones tecnológicas tienen la capacidad de influir en la opinión pública.

- Dependencia de la automatización: Las decisiones algorítmicas pueden reemplazar el criterio humano en la moderación.

Posibles soluciones

Para abordar estos desafíos, se sugieren varias medidas:

- Mayor transparencia en los algoritmos de moderación.

- Supervisión humana combinada con IA para evitar errores injustos.

- Derecho a apelar las decisiones de censura mediante procesos claros y accesibles.

El uso de inteligencia artificial en la moderación de contenido plantea un dilema entre seguridad y libertad de expresión. La clave está en desarrollar sistemas más justos y transparentes que equilibren la eliminación del contenido nocivo sin comprometer el derecho a la información y el debate abierto en la sociedad digital.